脳+AI時代の透視図

ーーERATO 脳 AI 融合プロジェクトメンバー 紺野大地氏に聞く(1)

脳と AI とを融合させるーーこれまで SF で描かれていたような世界が現実になりつつある。イーロン・マスクが設立した Neuralink をはじめ、脳とコンピュータをつなぐ BMI (Brain Machine Interface)の新技術が、陸続と発表されている。東京大学の松尾豊研究室で人工知能について、さらに池谷裕二研究室で脳の基礎研究に従事しつつ、池谷教授の「ERATO 脳 AI 融合プロジェクト」に参画する紺野大地氏に、その最前線と未来像を聞いた。

2022 年 11 月 4日 オンラインにて

|

紺野 大地(こんの だいち) 医師・神経科学者。1991 年、山形県生まれ。2015 年、東京大学医学部卒業。2018 年、東京大学大学院医学系研究科博士課程入学。東京大学医学部附属病院老年病科医師。池谷裕二研究室と松尾豊研究室にて脳と人工知能の基礎研究に従事。「ERATO 池谷脳 AI プロジェクト」メンバーとして脳や人工知能の研究を通じて「脳の限界はどこにあり、テクノロジーによりその限界をどこまで拡張できるのか」を探究している。 著書『脳と人工知能をつないだら、人間の能力はどこまで拡張できるのか 脳AI融合の最前線』(講談社)。Twitter(@_daichikonno)や NOTE(https://note.com/daichi_konno/)で脳・人工知能・老化について情報発信するほか、メルマガ”BrainTech Review”で最新研究を紹介する。 |

目次

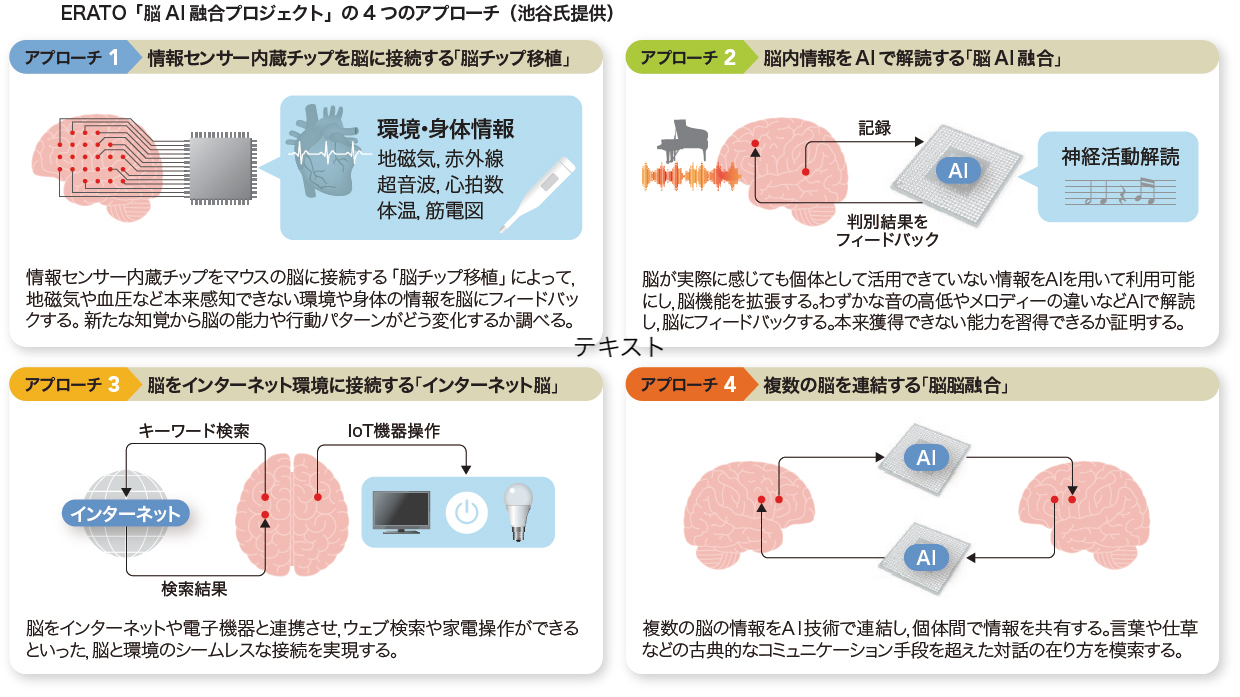

脳 AI プロジェクトの 4 つのアプローチ

都築正明(以下、――) まず、先生の取り組まれている「脳 AI 融合プロジェクト」の内容についてお聞かせください。

紺野大地氏(以下、紺野) 4 つのアプローチから進めています。 1 つめが「脳チップ移植」です。これは、私たちの脳が、生まれつき持っている五感のほかの感覚を知覚する能力を持っているのではないか、という疑問から出発しています。言葉を変えれば、私たちが脳の能力を使いこなせていないだけではないか、ということですね。そこで、脳に地磁気や赤外線を感じるセンサーチップなどを直接埋め込んで、五感では感じられないような情報をフィードバックして、脳がそれを活用できるようになるかを実験しています。こちらについては、ネズミが地磁気の情報を柔軟に使って迷路を解くことができる、という研究結果を 2015 年に論文発表しています。原理的には、地磁気だけでなく、赤外線や超音波などについても感覚を拡張することが可能だと思います。また、そこから発想を広げて、心拍数や体温、筋電位など体内からの情報を脳にフィードバックして、それらを意図的にコントロールできるようにならないか、ということにも取り組んでいきたいと考えています。

―― 体内のシグナルを使うことで、たとえば筋電図の情報をフィードバックして、義肢を動かすようなことが可能になるのでしょうか。

紺野 そうですね。仮に心拍数や体温を自分でコントロールできるようになれば、不整脈や頻脈があるときや、熱が通常より高くなっている時に、自分の意図で下げたりすることもできます。血糖値が制御できれば、糖尿病に対する新たな治療法を生み出すことができるのではないか、ということも考えています。地磁気や赤外線、超音波などの外部からのシグナルについては、患者さんへの適用というよりは、脳の限界を拡張していこうというポジティブな動機から進めています。

―― 幻肢痛を持つ患者さんに、失っていない腕を鏡に映して見ることで治療する、ラマチャンドランのミラーボックスのような治療が、あらゆることで可能になるかもしれない、ということでしょうか。

紺野 おっしゃる通りだと思います。

知覚を拡張する「脳 AI 融合」

―― 2 つめの「脳 AI 融合」についてお聞かせください。

紺野 「脳 AI 融合」は、脳が実際に感じているにもかかわらず個体として活用できていない情報を、AI を用いて利用可能にするアプローチです。利用可能になった情報を脳にフィードバックすることで脳機能を拡張することができるのではないか、と考えています。たとえば私たちの研究室では、ネズミが英語とスペイン語を聞き分けられるか、という研究をしています。そのままの状態では、ネズミは 2 つの言語を聞き分けることはできません。ただし、英語とスペイン語とでは、使用する音が違う――つまり鼓膜の振動のレベルでは異なります。鼓膜から脳に入る最初の領域として一次聴覚野という部位があるのですが、この一次聴覚野の段階でも、英語とスペイン語を聞いた時の脳の活動が違うというところまでが、実験でわかりました。つまり、英語とスペイン語とは、脳に入ってきた時点では違う情報だということです。2 つの用語の聞き分けができないのは、一次聴覚野よりも先の意思決定に至るまでの時点で区別ができなくなっているからです。私たちが注目しているのは、脳の中に情報はあってもそれを使えていない、ということです。情報として異なるのであれば、それぞれの言語を聞いたときの脳の活動を AI によって分類して「これは英語です、これはスペイン語です」と脳にフィードバックすれば、聞いたものが英語なのかスペイン語なのかを、認識することになります。いわば AI に教わるように、その都度それぞれの言語を認識する、ということを繰り返していき、いずれ AI による分類なしで英語とスペイン語の聞き分けができるようになれば、脳の機能が AI の力を借りて拡張されたと考えられる──私たちはそう考えています。この応用としては、私たち日本人が苦手とされる英語の“L” と“R”の聞き分けもできそうですし、絶対音感のない人が絶対音感を身につけるといったことにも使えるのではないかと考えています。

―― 学習というよりも、知覚を拡張するわけですね。

紺野 はい。今までできたことをより早く・より正確に、というよりは、今まで人間ができなかったようなことを可能にしたいと考えています。

―― 3 つめの「インターネット脳」についてはいかがでしょう。

紺野 脳活動だけを使って IoT 機器のスイッチを切り替えたり、その人が頭の中に思い浮かべている言葉をインターネット検索して、検索結果を返してあげることを考えています。現在はネズミが脳波によって部屋の明るさをコントロールする実験を進めています。

―― 実現すれば、医学的な意義は相当高いものになりそうですね。

紺野 そうですね。まずは ALS(Amyotrophic Lateral Sclerosis:筋萎縮性側索硬化症) や四肢麻痺の患者さんにご利用いただけると思います。将来的に、健康な人にも応用できれば、念じるだけで検索する、といったこともできると思っています。

―― 従来そういった病気を持たれている方は視線の動きと 50 音表をつかった会話などをしていました。また、参議院では発話障害を持つれいわ新選組の天畠大輔議員が独自の「あかさたな話法」で質問して話題にもなりました。

紺野 脳の活動だけでの会話が可能になることで、そういった患者さんの負担も少なくなってほしい、というのが私たちの思いです。将来的には、健康な人も利用できるようになればよいと思っています。

脳の活動が可視化されることで医療診断も大きく変わる

―― 4つめの「脳脳融合」はどういったものでしょう。

紺野 これまでご説明した 3 つのアプローチは、デバイスや環境と脳との相互作用ですが、この 4 つめの「脳脳融合」については、脳と脳とを直接繋いでしまうという発想です。私がいま頭の中で想像している言葉をみなさんに直接伝えるテレパシーのようなことも考えられますし、さらに言葉にはできないような感覚、たとえば私が感じる赤い色をダイレクトに伝えることも考えられます。また、痛みの感覚などを伝えることも可能だと思っています。

―― たとえば頭痛のとき、医師に「ズキズキ痛みますか、それともシクシク痛みますか」と聞かれて「どちらかというとキリキリ痛みます」と答えたりしつつ、そのオノマトペが正確かどうか不安になることがあります。

紺野 確かにそういった症状の伝達にも使えますね。

―― 抑うつ症状をそのまま伝えることが可能になると、神経症の患者さんにたいする治療も大きく変わりそうですね。

紺野 うつなどの神経症については、今のところ明確なバイオマーカーがありませんから、診断や治療の多くが医師の経験則などに委ねられています。脳の活動が可視化されることで、そういった診断が大きく変わるだけでなく、より多くの患者さんに届くものになるかと思います。

―― 第 2 次 AI ブームまでの AI はルールベースでできていたので、バイオマーカーのあるものをルールに基づいて演繹的に処理することに秀でていました。第 3 次 AI のディープラーニングでは、帰納的な手法でアウトプットがなされるので、バイオマーカーのないものを扱うことが得意になってきた、ということでしょうか。ブラックボックス化は進んだけれども、そのブラックボックス性ゆえに判断できることもある、というような。

紺野 そうだと思います。 血圧が高いから高血圧、血糖値が高いから糖尿病と診断されるのは人間として納得感は高いのですが、この先、精神疾患への 応用が高まっていくと、例えばこういう目線の動きをした時はうつ病だ、ということも出てくると思います。さらには目の動きだけでなく、うつ病の患者さんで顕著に高い何らかの特徴があり、理由はわからないけれど、診断基準として精度が高い、ということが今後必ず出てくると思います。理由はわからなくても、それが正確であれば、医学的には役立ちますし、そこから研究が進んでいくこともあります。ペニシリンなどの抗生剤は、発見当初はどうして効くのかがわかりませんでしたが、人が治癒していくシステムが解明されていきました。もしかしたら、将来的に精神疾患研究のブレークスルーも、そういったことから起こるかもしれません。

―― 現在、教育の現場では多くの子どもが LD(Learning Disability:学習障害) や ADHD(Attention-Deficit Hyperactivity Disorder:注意欠陥・多動性障害)などの発達障害であると判定されます。ただし医療側には、小児科と精神科の一部ぐらいの受け皿しかありません。こうした現状に、先生の研究が役立つことがあるでしょうか。

紺野 アプローチ 2 の脳 AI 融合には、AI が自分だけでは出せないような問題の解答を教えてくれて、それを繰り返してトレーニングするうちに、自分 1 人でも解けるようになる、というコンセプトがあります。ですから、LD のように学習のどこかのフェーズに問題があるような場合にはそこをバイパスする、もしくは克服するような学習の仕方を実現できるといいな、と思います。

―― 学校の教員が恣意的に発達障害の判定をするよりも、発話や行動の類型を解析して、科学的に判定できると、子どもの将来への道筋がつけやすいと思うのですが。

紺野 確かにそれはできそうな気がします。

出典:BCI研究が描く2050年の医療(栁澤琢史,池谷裕二,金井良太,川合謙介,西村幸男)2022.01.03 週刊医学界新聞(通常号)

―― 疾患中心の医療から個人中心のオーダーメイド医療へ、ということも、かなり精度が高く実現できそうですね。

紺野 研究をしていて、そこはこれまでと大きく変わっていくだろうと実感しています。